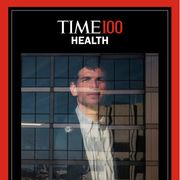

Tempo di regole nella partita globale dell’AI paolo benanti

Sembra che la sfida delle intelligenze artificiali, in questo momento di vuoto regolamentatorio e legislativo,

Sembra che la sfida delle intelligenze artificiali, in questo momento di vuoto regolamentatorio e legislativo, abbia bisogno di un’alleanza tra pubblico e privato. Martedì otto aziende tecnologiche si sono unite all'impegno della Casa Bianca per la gestione dei rischi legati all'intelligenza artificiale. Adobe, Cohere, Ibm, Nvidia, Palantir, Salesforce, Scale AI e Stability si sono aggiunte alle prime sette che con Washington in luglio avevano volontariamente sottoscritto una serie di impegni per la supervisione delle modalità di sviluppo e uso della tecnologia emergente. Le prime aziende ad accettare gli impegni erano state Amazon, Anthropic, Google, Inflection, Meta, Microsoft e OpenAI. Questa azione seguiva il fatto che l'amministrazione Biden aveva dichiarato che questi impegni erano un passo immediato e un importante ponte verso il governo delle AI in vista di un futuro ordine esecutivo del presidente e nel tempo che serve ai legislatori per prendere in considerazione una legislazione. Da quanto si è saputo dopo l’incontro alla Casa Bianca, Biden ha un ordine esecutivo in cantiere: l’Office of Management and Budget «rilascerà presto una bozza di orientamento politico per le agenzie federali, per garantire che lo sviluppo, l’approvvigionamento e l’uso dei sistemi di AI siano incentrati sulla salvaguardia dei diritti e della sicurezza del popolo americano». Gli impegni che le aziende hanno scelto di assumere sottolineano tre principi fondamentali per il futuro dell’AI: sicurezza, protezione e fiducia. Con la loro dirompente innovazione, le AI segnano una novità: il regolato e il regolatore si incontrano e sembrano venirsi incontro in una maniera senza precedenti. Durante la conferenza stampa si è sottolineato che «mentre il ritmo dell'innovazione continua ad accelerare, l'Amministrazione Biden-Harris continuerà a intraprendere azioni decisive per mantenere gli americani al sicuro e proteggere i loro diritti». Le aziende hanno accettato otto impegni, che vanno dall'apertura dei loro algoritmi ai test di sicurezza, alla condivisione delle informazioni su di essi prima del lancio, fino a una serie di misure che pongono la sicurezza, la trasparenza e la responsabilità al centro nei loro prodotti. Questi impegni integrano le azioni degli alleati degli Stati Uniti, come il processo di Hiroshima del G-7 del Giappone, il vertice sulla sicurezza dell'AI del Regno Unito e la leadership dell'India come presidente della «Global Partnership on AI». Non sembrano essere però tutte rose e fiori: alcuni esperti di regolamentazione della tecnologia sostengono che questi quadri di riferimento sono intrinsecamente contraddittori e forniscono indicazioni confuse alle aziende. Insomma, una corretta posizione algoretica ci chiede di guardare con attenzione a quanto accade perché lo sviluppo delle AI rimanga capace di rispettare la dignità della persona umana. © riproduzione riservata

© RIPRODUZIONE RISERVATA