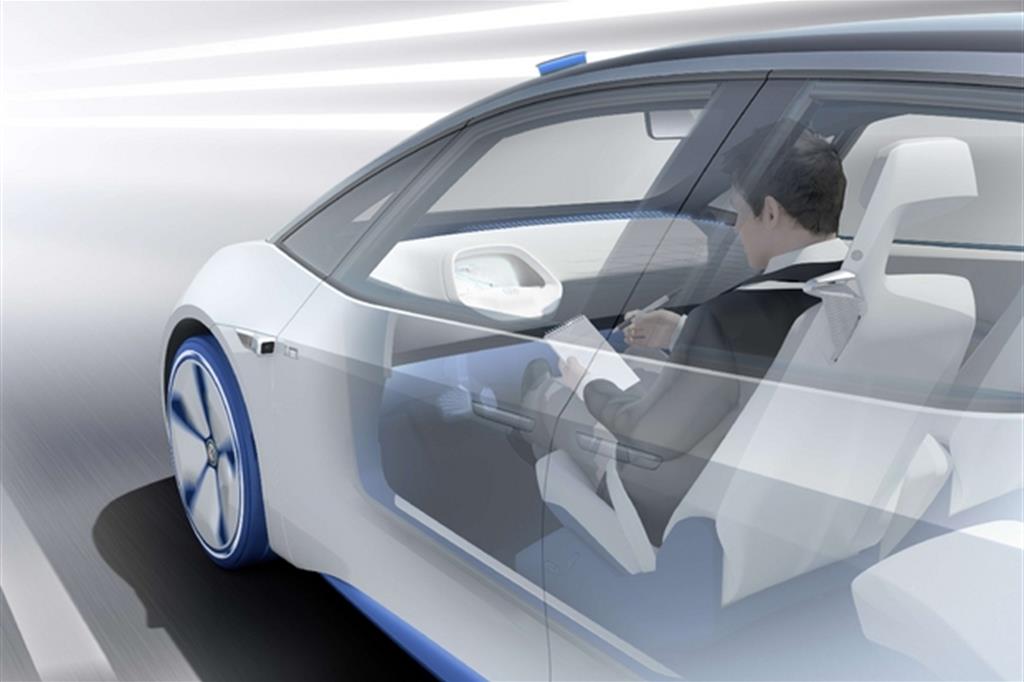

La guida autonoma, grande rebus della mobilità del futuro

Ferire o ferirsi? La libera scelta e l’etica della robotica, sempre che esista. O che qualcuno nel frattempo l’abbia inventata. Uno dei più grandi problemi relativi allo sviluppo della guida autonoma è legato all'eventuale incidente stradale, proprio la circostanza cioè che questo tipo di tecnologia mira ad eliminare del tutto. La domanda, più precisamente, è questa: come reagirà il software di controllo della vettura nel caso dovesse decidere se investire qualcuno o qualcosa per salvare gli occupanti dell'auto? Cosa deciderà di fare insomma il computer che in quel momento sta guidando al posto nostro?

Sono interrogativi che fino a ieri erano da film di fantascienza. E che invece oggi sono quanto mai attuali, visto lo sviluppo rapidissimo della tecnologia che riguarda le auto senza pilota, già in circolazione a livello sperimentale in California, in Svezia e in altri Paesi. Sul tema, e sui problemi che propone anche a livello normativo, si è aperto un dibattito soprattutto negli Stati Uniti dove questo tipo di vetture sono già considerate come quasi “normali” sulle strade comuni. Ma la prima nazione a varare le linee guida sull'argomento è la Germania, che nei giorni scorsi ha approvato un documento frutto del lavoro di una apposita commissione di 14 esperti (giuristi, filosofi, teologi, ingegneri, rappresentanti dei consumatori e specialisti della protezione dei dati), presieduto dall’ex giudice della Corte Costituzionale Udo di Fabio.

Con un impegno rivendicato come pioneristico, il ministro federale dei Trasporti, Alex Dobrindt, ha spiegato che la Commissione ha stabilito - in maniera piuttosto ovvia in realtà - che per i software che le gestiscono, la priorità assoluta delle auto a guida autonoma è evitare morti e feriti, eventualmente a scapito di cose e animali. L’intelligenza artificiale cioè “non deve discriminare gli umani per età, genere, razza o altre condizioni”. Soprattutto, confermando le promesse dei costruttori, la Commissione “benedice” la guida autonoma solo se questa porta maggiore sicurezza sulle strade, tanto da rendere addirittura impossibili gli incidenti.

Gli esperti, suddivisi in gruppi di lavoro, hanno suggerito al Governo i “venti comandamenti” fra i quali c’è anche quello che esclude distinzioni in caso di sinistro: i programmi devono rivelare a chi attribuire la responsabilità, se all’uomo o alla macchina, ad esempio. Per i dati di un’eventuale “scatola nera”, la Commissione suggerisce l’istituzione di un organismo indipendente che abbia il compito di valutarli. Ma ha comunque anticipato di non poter prevedere cosa sarà in grado di offrire la tecnologia in futuro. Insomma, nessuno ancora riesce a risolvere il vero cuore della questione, cioè le regole che la macchina deve applicare nei casi in cui gli incidenti sono inevitabili, con conseguenze mortali per le persone.

Illuminante in proposito è una una ricerca condotta da un gruppo di psicologi che lavorano per il Massachusset Institute of Tecnology, l’Oregon University e la School of Economics di Tolosa. Partendo dal presupposto scientifico secondo il quale è difficilissimo ottenere un algoritmo che porti un’automobile a gestire dilemmi morali, i ricercatori sostengono che le vetture a guida autonoma «dovranno conoscere i fondamenti dell’utilitarismo», ovvero di quel ragionamento «che porta un umano a sacrificare una vita anziché molte vite». Anche qui, più o meno, la scoperta dell'acqua calda. Parole, per ora, solo parole. Che la tecnologia ancora non riesce a trasformare in fatti.

berezko.jpg?dt=1721214022875&Width=300)

berezko.jpg?dt=1721214022875&width=677)