86 miliardi di neuroni “svelano” i nostri pensieri

Studiare il funzionamento del cervello per mettere a punto terapie, farmaci e interfacce sempre più efficaci. La frontiera delle conoscenze sull’attività cerebrale umana si sta spostando verso le intenzioni e le scelte. Una immensa quantità di dati, elaborati grazie all’IA

Più di 150 anni fa Emily Dickinson aveva già compreso poeticamente la vertiginosa profondità del nostro sistema nervoso e l’aveva resa nei suoi famosi versi: «Il Cervello - è più ampio del Cielo / Perché – mettili l’uno accanto all’altro – / L’uno contiene l’altro / Con facilità – e Te – inoltre» (qui tradotti da Amelia Rosselli). La scienza, più prosaicamente, cerca di comprenderne il funzionamento a scopi di cura. All’epoca della scrittrice americana si poteva osservare la materia grigia quasi esclusivamente post-mortem, con l’apertura del cranio durante l’autopsia. Oggi stiamo provando a leggere la formazione dei pensieri, anche se lo scopo non è il controllo delle coscienze.

Lo spunto più recente arriva dal progetto AHEAD (AI-driven High-density Electrophysiology for Advanced Drug Discovery) un’iniziativa di ricerca da oltre 4 milioni di euro, cofinanziata dalla Regione Lombardia, che mira a sviluppare una nuova piattaforma per studiare il cervello con un livello di dettaglio finora difficilmente raggiungibile, ovvero l’attività elettrica dei singoli neuroni (ne abbiamo complessivamente 86 miliardi). Promosso dalla startup Corticale, dall’azienda informatica Inmatica e dall’Istituto Mario Negri, lo studio ha un obiettivo per ora preclinico. Si punta infatti a creare uno strumento utile a comprendere meglio i meccanismi dei danni neurologici acuti e cronici e a valutare più rapidamente l’efficacia di nuovi farmaci.

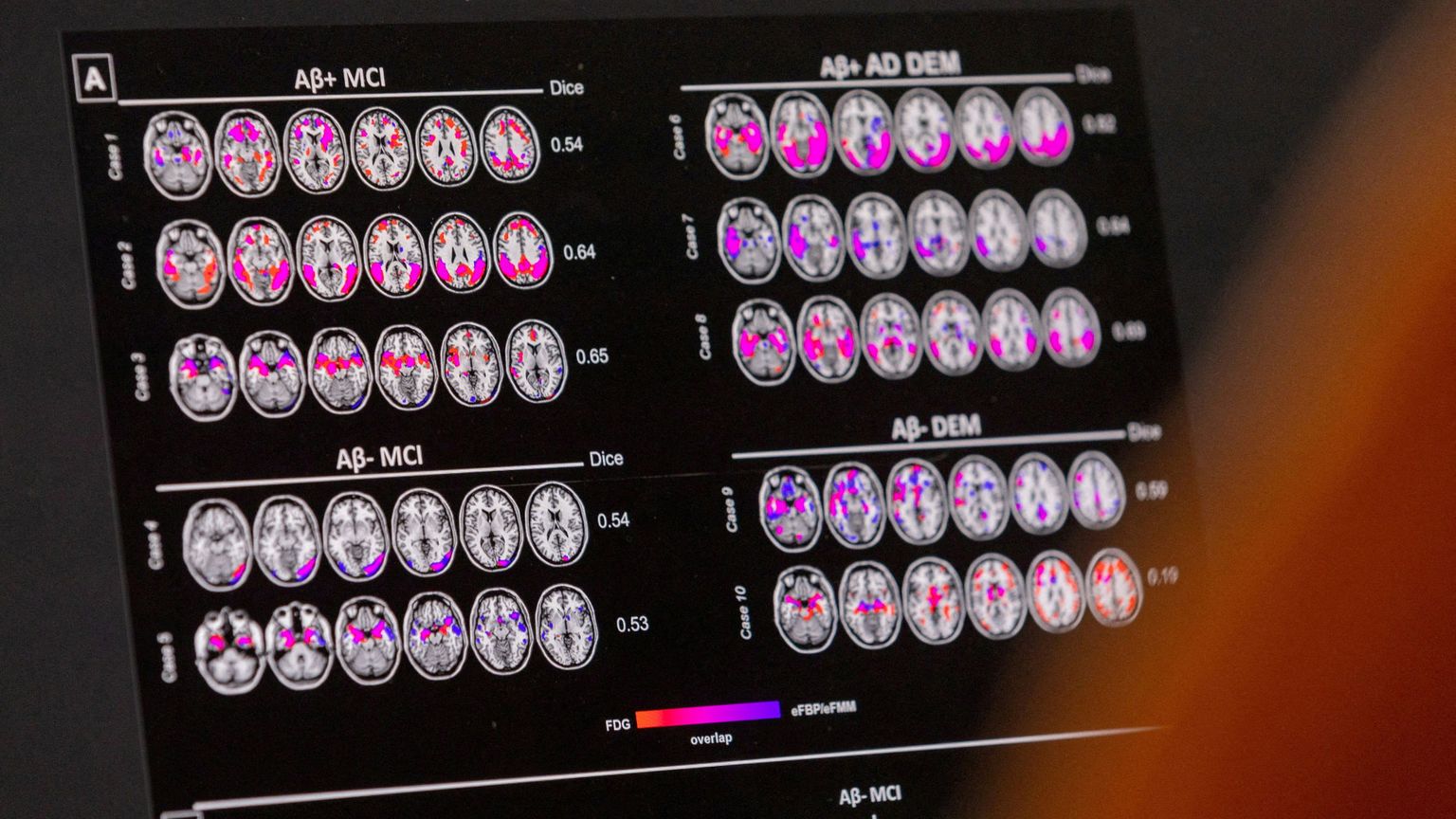

AHEAD si basa su una piattaforma di elettrofisiologia ad altissima densità, cioè su sensori in grado di registrare simultaneamente l’attività elettrica di molti neuroni, fino ad arrivare al livello della singola cellula nervosa. Tecnologie di questo tipo sono già note in ambito neuroscientifico, ma il progetto mira ad aumentarne la risoluzione e soprattutto a migliorare la capacità di analizzare l’enorme quantità di dati generata. Qui entra in gioco l’intelligenza artificiale: i segnali raccolti verranno elaborati tramite algoritmi di machine learning per individuare schemi di attivazione ricorrenti, risposte cellulari a specifici danni o a cambiamenti indotti da potenziali trattamenti neuroprotettivi. Questo approccio potrebbe rendere più rapida e selettiva la fase iniziale della ricerca di terapie, oggi lunga e costosa. I promotori parlano di un possibile “salto tecnologico”, mentre le principali sfide restano l’affidabilità dell’interpretazione dei dati e la distinzione tra segnali biologicamente rilevanti e il tipico “rumore” sperimentale.

Gli sforzi di decodifica dell’attività cerebrale per aiutare coloro che per diverse patologie sono limitati nel movimento e nella parola stanno procedendo a un ritmo rapidissimo. Con l’espressione ancora impropria di mind-reading (lettura della mente) si indica un insieme di diverse tecnologie. Il primo gruppo è basato su elettrodi impiantati nel cervello, che possono tradurre in testo o comandi il linguaggio immaginato o l’intenzione di compiere un’azione. Sono le interfacce per ora impiegate a livello sperimentale, come quelle di Neuralink, molto pubblicizzate dal loro proprietario Elon Musk.

Uno tra gli studi più interessanti del 2025 è quello di un gruppo di ricercatori della Stanford University in cui si mostra, in modo controllato, che un impianto neuronale può decodificare il linguaggio interno – cioè, le parole che una persona pensa senza pronunciarle – a partire dall’attività registrata direttamente dalla corteccia motoria dell’eloquio. Il meccanismo combina microelettrodi impiantati con modelli di intelligenza artificiale in grado di interpretare gli schemi di attività legati all’immaginare parole. Nei test su quattro pazienti con gravi compromissioni del linguaggio, il sistema ha raggiunto fino al 74 % di accuratezza nella decodifica di frasi immaginate.

Per affrontare una questione cruciale di privacy e controllo dell’utente, i ricercatori hanno introdotto – ed è la prima volta in questo modo – una sorta di password cerebrale: la decodifica dei segnali interni si attiva solo quando l’utente pensa deliberatamente una parola specifica o una frase prestabilita.

Il secondo filone è quello delle interfacce neuromuscolari, che leggono segnali periferici legati alla parola o al movimento “pensato”, come la subvocalizzazione. Sono non invasive e più pratiche, ma non accedono ai contenuti mentali profondi. Ha fatto però scalpore l’annuncio in settembre di AlterEgo, un dispositivo indossabile tra mandibola, orecchie e nuca, sviluppato a partire da ricerche del Mit Media Lab, che promette di consentire una forma di comunicazione silenziosa e di controllo di dispositivi digitali senza usare voce, mani né schermi.

AlterEgo rileva i segnali neuromuscolari periferici associati, come detto, alla subvocalizzazione. Essi vengono interpretati da sistemi di IA e tradotti in testo o comandi digitali. Un video dell’azienda mostra quella che sembra una conversazione telepatica. In realtà, il messaggio non viene “letto” nella mente, ed è restituito all’utente come una percezione privata, attraverso vibrazioni che si trasmettono per via ossea al sistema uditivo del ricevente. Il sistema accede solo a intenzioni linguistiche già “incanalate” nel sistema motorio del linguaggio e non a pensieri o stati emotivi. Inoltre, richiede probabilmente addestramento individuale su un vocabolario limitato.

Il terzo gruppo di tecnologie è rappresentato dal neuroimaging avanzato (risonanza magnetica funzionale), tramite il quale si cerca di ricostruire immagini, parole o stati mentali a partire da grandi correlazioni statistiche, con risultati interessanti (per esempio, individuare a quale concetto della fisica, entro un elenco noto, un soggetto stia pensando). Si è tuttavia ancora lontani da un uso pienamente affidabile.

Infine, ci si spinge nella predizione di ciò che un individuo sta programmando di fare, dove sistemi di intelligenza artificiale individuano segnali cerebrali che precedono la consapevolezza cosciente di una decisione. Qui non si leggono pensieri, ma fasi molto precoci della preparazione all’azione. Un articolo pubblicato su Nature nel novembre scorso ha raccontato come alcune interfacce cervello-computer, potenziate da algoritmi di IA, stiano raggiungendo la capacità di rilevare segnali neuronali legati alle intenzioni prima ancora che una persona ne sia pienamente cosciente.

Questo non significa rendere reale la fantascienza del film Minority Report, con la prevenzione di crimini solo pensati. Piuttosto i modelli possono identificare l’attività cerebrale associata alla preparazione di un’azione. Per esempio, in persone con impianti che permettono loro di controllare una tastiera o creare semplici suoni soltanto immaginando di farlo, il sistema coglie i segnali legati all’intenzione di premere un tasto prima che il soggetto se ne renda conto pienamente, un po’ come nei famosi esperimenti di Benjamin Libet che sembravano mettere in discussione il libero arbitrio.

Questi sviluppi aprono prospettive cliniche importanti. La capacità del dispositivo di prevedere un’intenzione “in formazione” può aiutare a creare interfacce più fluide per la comunicazione o il controllo di protesi e computer. Allo stesso tempo, non si possono sottovalutare i rischi etici e di privacy. Se le tecnologie diventano in grado di predire che cosa faremo prima che i nostri piani divengano pensieri coscienti si apre una questione delicata. Bisogna riflettere su chi controlla questi dati, su come vengono usati e su quali garanzie esistono per evitare interpretazioni non desiderate o manipolazioni dirette degli stati mentali privati. Oggi la preoccupazione riguarda i pazienti, domani potrebbe estendersi anche a persone sane che vorranno o saranno indotte a usare le neurotecnologie per migliorare le proprie prestazioni.

Puoi abbonarti alla newsletter settimanale gratuita di Avvenire su Vita, Bioetica e Cura CLICCANDO QUI: potrai registrarti ad Avvenire.it e poi iscriverti per l’invio settimanale. Se sei già registrato ad Avvenire.it è sufficiente introdurre le tue credenziali e poi abbonarti alla newsletter.

© RIPRODUZIONE RISERVATA